Insight Navi

音声感情解析

なぜ音声から感情がわかるのか? 声に宿る“感情”を読み解く

2025.04.04

お知らせ

なぜ音声から感情がわかるのか? 声に宿る“感情”を読み解く

1. はじめに|声に宿る「本音」は、無意識にこそ現れる

- 人は話している言葉以上に、「声の質」に本音や心理状態が現れる。

- 実際、声のトーン・スピード・間・音圧・震えなどの“揺らぎ”には、無意識の感情が反映されている。

- 当社の音声感情解析は、言語によらず非侵襲で本音を可視化する技術である。

2. なぜ声に感情が現れるのか?|生理反応としての“声の変化”

- 感情は、脳が自律神経を介して身体に反応を起こす現象。

- それにより発声器官(喉・声帯)や呼吸パターンに影響が生じ、声の微細な変化を生む。

- たとえば「怒り」は音量とピッチ上昇、「不安」はトーンの震えや語尾の曖昧さに現れる。

3. 音声感情解析のメカニズム|LVA(Layered Voice Analysis)技術とは

- Nemesysco社が開発したLVA技術は、人の声に含まれる複数層のマイクロ変化を同時解析する。

- キーワード:“Voice Micro-tremors(声の微細振動)”

人間が制御できない、非随意的な声の揺らぎが解析対象。 - 感情状態(ストレス、興奮、緊張、安心など)をリアルタイムかつ非言語情報から抽出可能。

- 特徴:

- 言語依存なし

- 録音データや通話音声にも適用可

- 疲労・ストレス・怒りなど、本人も気づいていない感情の兆候をも検出可能

4. 当社の技術の特長|“意識の奥”にある感情を捉える力

- 当社の解析技術は、Nemesysco社LVAの正規ライセンス技術を採用し、独自に国内向けにチューニング。

- 日本語環境・通話品質・発話文化への最適化により、高精度・高信頼性の感情可視化を実現。

- 本人の自覚がない“非随意的な感情変化”を捉えることも可能であり、

- メンタルヘルスケア

- 離職リスクの予兆検出

- 顧客の潜在的不満の感知

- 商談中の本音・躊躇・納得感の推定

- お客様苦情の検知や予測

に活用されている。

5. “言葉にならない本音”を可視化する意味

- 顧客満足度・従業員満足度・エンゲージメント・信頼度などの数値化しにくいKPIが可視化できる。

- ストレスや不安の兆候を検知し打ち手を講じることができる。

- 表情分析やテキスト分析では解析できない領域での活用

関連リンク

ESジャパン株式会社 警察向け捜査支援ツール LVA6.50公式認定取得― さらなる専門性と信頼性を提供 ―

CENTRICグループ、音声感情解析専門会社のESジャパン 音声感情解析が警察の複数の捜査過程で活用されました

音声感情解析サービス「ESAS」を活用し、オペレーターの音声をモニタリングしてうつ症状を早期に予測 ―産業医科大学と共同研究、音声感情解析技術によるうつ症状早期検出モデルの実証開始―

関連記事

-

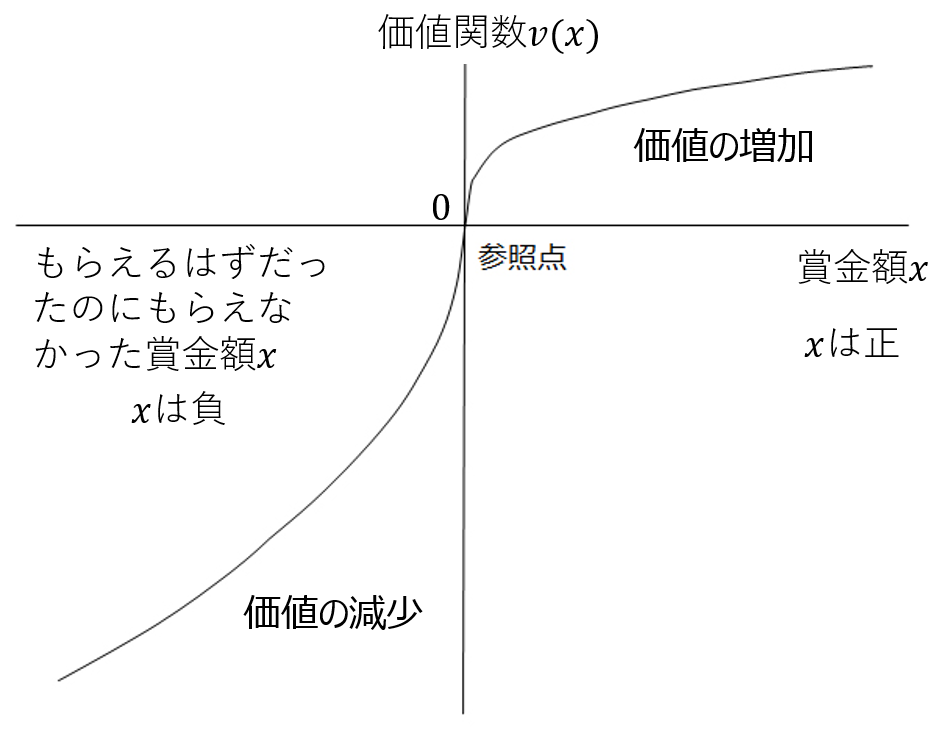

047パーソナルキャラクターと意志決定(2) (プロスペクト理論について)

-

60 日本のトップコールセンター(CENTRIC)での感情検出 (提携先であるネメシスコ社の子会社であるEmotion Logic社のブログから)

-

36 説得力のある話し方を鍛える画期的な方法(1)(信頼されるコールセンターオペレーターを養成しよう)

-

53 感情の5つの役割

-

42 コールセンターの新しい潮流(2) (お客様の性格が数分間の会話でわかります)

-

43 コールセンターと音声感情解析を組込んだメタバース

-

ESジャパンの公式YouTubeチャンネルを開設しました。

-

55ビジネスで音声感情解析システムはどのように使われるのか(連載3) 《保険金請求審査》

ピックアップ

- 人気記事

- 15 音声感情解析システムを提供している世界の企業

- ESジャパンの公式YouTubeチャンネルを開設しました。

- 26 警察捜査にも活用される音声感情解析システム(従来方式の歴史と問題点)

- 57 ビジネスで音声感情解析システムはどのように使われるのか(連載5) 《Alexaでの音声感情解析》

- 8 音声の特徴と感情の関係

テーマ

- 感情

- パスカル

- 等ラウドネス曲線

- 音の性質

- デシベル

- 音速

- 周波数

- LVA

- フォーマント

- 解析

- コールセンター

- 運営効率

- パーソナリティー

- 性格診断

- オペレーター感情

- モチベーション

- コールセンター運営

- サイエンスラボ

- 音声解析研究

- 応対品質

- 基盤技術

- ビジネス予測

- 感情解析ビジネス

- 米国心理学会

- 発声機構

- 聴覚機構

- 米国特許

- 学術論文

- 周波数分析

- Nemesysco

- ネメシスコ

- 人事面接

- 聞き手。理解度、音声感情解析

- 聞き手

- 理解度

- パーソナルキャラクター

- ソーシャルスタイル

- DISC理論

- メタバース

- 音声感情

- AI

- コールセンター、品質管理

- 音声感情解析

- 期待効用理論、効用関数

- ベルヌーイ

- ESAS

- 感情解析ラボ

- プロスペクト理論

- 価値関数

- 言語

- 不随意感情情報

- 意図的感情情報

- 音声感情解析、AI、機械学習

- 音の波形

- フーリエ変換

- Chat-GPT、AI、感情、音声

- 警察

- 情報機関

- 人事部門

- 面接

- 採用

- ストレスチェック

- リモートミーティング

- ロボット

- エンタメ

- カラオケ採点

- 学習理解度把握

- 愛情チェック

- 役割

- 機能

- 教育、中国、学習量、学習効率

- 保険請求

- 不正申告

- 保険

- 詐欺

- アレクサ

- Alexa

- amazon

- アマゾン

- 住民感情、コロナ、自治体

- エモーションロジック

- 不正請求

- 保険金詐欺

- Insurance Fraud

- 保険金

- Voice Screen

- ストレス

- 感情分析

- メディア掲載

- BSテレビ東京

- 応対評価

- 感情解析

- 応対品質評価

- 音声認識

- 生成AI

- 自動評価

- CENTRIC

- Dr.Tel

- 業務提携

- 顧客体験

- クレーム予兆

- 品質改善

- 離職抑止

- 顧客満足度

- ありがとう率

- 警察捜査支援

- 非言語情報

- 音声AI

- 金融機関

- ローン審査

- 与信判断

- フィンテック

- 海外事例

- ペルー

- 信頼性評価

- 詐欺防止

- 顧客審査

- リスク管理

- 不正検出

- 声のトーン

- 声と感情

- 非言語コミュニケーション

- LVA技術

- 感情検出